Menschen verarbeiten Erlerntes vor allem nachts, wenn in der Tiefschlafphase bestimmte Wirkmechanismen im Gehirn ablaufen. Wie das Fachmagazin „Entwicklung & Elektronik“ (E&E) berichtet, haben Forscher der TU Ilmenau diese Abläufe nun auf künstliche neuronale Netze übertragen, um „Machine Learning“ effizienter zu machen.

„Schon häufig haben Wissenschaftler neue Methoden entwickelt, die auf Beobachtungen aus der Natur basieren“, schreiben die Forscher um Prof. Patrick Mäder von der TU Ilmenau im Vorwort ihrer Studie, für die sie den biologischen Prozess des Lernens auf künstliche neuronale Netze übertragen und damit deren Leistungsfähigkeit steigern konnten.

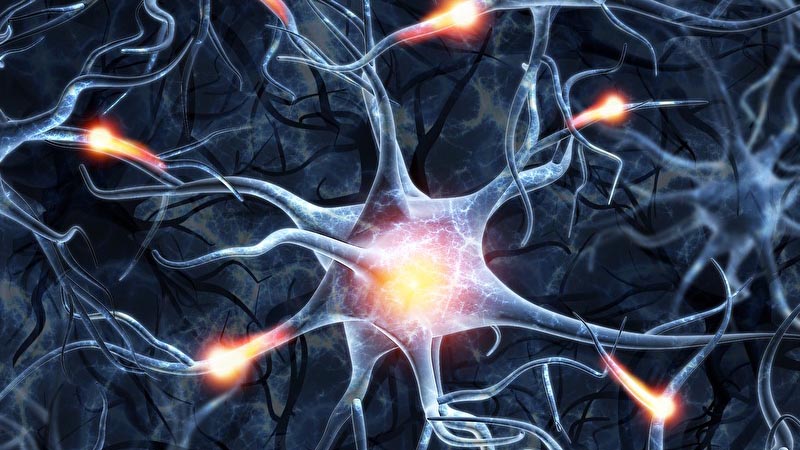

Zum Hintergrund: Laut „E&E“ wissen Schlafforscher erst seit wenigen Jahren, wie nächtliches Lernen funktioniert. Diese Erkenntnisse bauten auf der Beobachtung auf, dass Synapsen während Wachphasen nicht nur aktiv lernen – sondern auch chemische oder elektrische Signale von Neuronen verstärken oder reduzieren. Die Synapsen leiten also Signale nicht nur von Nervenzelle zu Nervenzelle weiter, sondern verstärken auch deren Intensität oder schwächen sie ab. „Auf diese Weise werden Neuronen in die Lage versetzt, die sich ändernden Einflüsse der Umgebung aufzunehmen und sich ihnen anzupassen“, erklären die Wissenschaftsjournalisten. Im Schlaf normalisiere sich dieser Erregungszustand wieder, und das Nervensystem können die in der Wachphase aufgenommenen neuen Informationen im Gedächtnis verarbeiten und durch Vergessen zufälliger oder unwichtiger Informationen verfestigen. Gleichzeitig werde es für die Aufnahme neuer Informationen empfindlicher.

Auf diesen Vorgang, genannt synaptische Plastizität, baute der Leiter des Fachgebiets Softwaretechnik für sicherheitskritische Systeme der TU Ilmenau, Prof. Patrick Mäder auf: „Die synaptische Plastizität ist für die Funktion und Leistungsfähigkeit unseres Gehirns verantwortlich und damit die Grundlage des Lernens“, wird er in „E&E“ zitiert: „Blieben die Synapsen immer in einem aktivierten Zustand, würde dies, wie wir aus Tierversuchen wissen, letztlich das Lernen erschweren. Erst die Erholungsphase während des Schlafs macht es möglich, dass wir das, was wir gelernt haben, im Gedächtnis behalten.“

Die Fähigkeit des synaptischen Systems, dynamisch auf unterschiedliche Reize reagieren zu können und das Nervensystem stabil zu halten, haben die Forscher demnach nun in künstlichen neuronalen Netzwerken nachgeahmt. Mithilfe der sogenannten synaptischen Skalierung übertragen sie die Mechanismen, die das Gehirn regulieren, auf Verfahren des maschinellen Lernens – mit dem Ergebnis, dass sich die künstlichen neuronalen Modelle ähnlich wirkungsvoll verhalten wie ihr natürliches Vorbild.

Text: Ingo Schenk

Am beliebtesten